液冷技术单价突破4万美元高功率AI服务器会不会成为下一代耗电怪兽?

发布时间:2026-03-22 19:42:11| 浏览次数:

高功率AI服务器的功耗确实在激增,但液冷技术恰恰是为了化解这一能耗危机而生的关键方案——它通过革命性的散热效率将AI服务器从耗电怪兽转化为可控的绿色算力引擎。

芯片级功耗爆发式增长:英伟达新一代Rubin GPU单芯片功耗达1950W,谷歌TPU v7单芯片超980W,远超传统风冷散热上限(30kW)。单机柜功率密度从GB300的140kW跃升至Rubin平台的200–220kW,风冷技术已触及物理天花板。

能效危机显性化:千亿参数大模型(如GPT-4)单次训练耗电2.4亿度,相当于3000户家庭年用电量;推理阶段能耗更达训练阶段的10倍。若不优化散热,2030年数据中心或消耗全球21%的电力。

液冷机柜单价虽达4万–10万美元,但其核心价值在于显著降低整体能耗成本。液冷PUE(电源使用效率)可压至1.05以下,较风冷节能超30%,余热还可接入采暖系统梯级利用。

效率碾压风冷:液体比热容是空气的25倍,导热效率提升数十倍,轻松应对万瓦级芯片散热。

适配高密度算力:浸没式液冷可支持单机柜900kW超高频部署,是风冷能力的30倍以上。

2025年AI数据中心液冷渗透率预计从10%飙升至90%,2026年全球市场规模从89亿美元翻倍至170亿美元。中国成为最大市场,规模占比超60%。

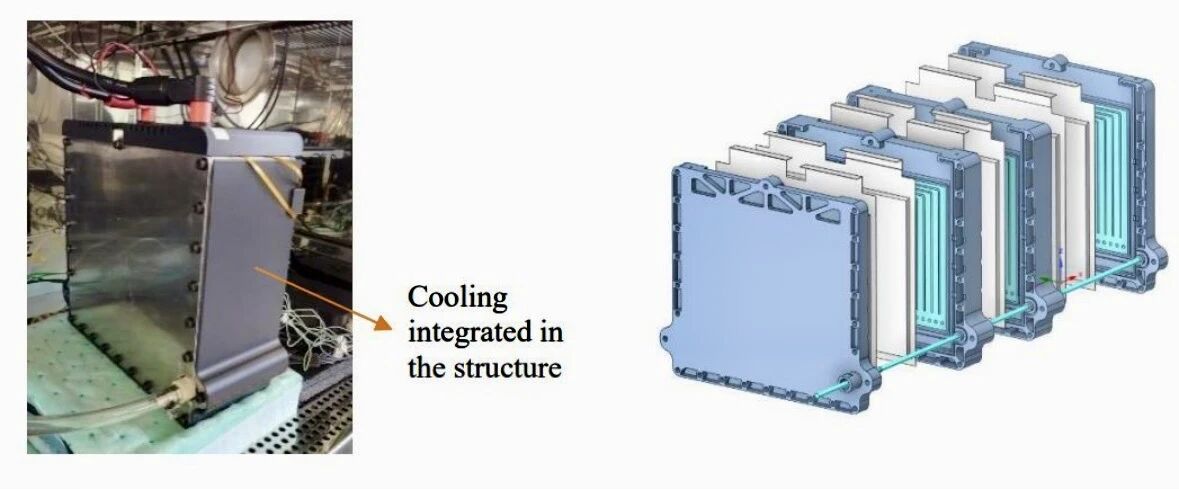

英伟达、谷歌等巨头将液冷定为下一代架构默认标准,Rubin平台已全面采用液冷方案。

国产液冷成本比海外低30%–40%,交付周期缩短50%,谷歌赴华采购英维克CDU等设备印证中国制造的成本与技术优势。

全链条自主可控:从氟化冷却液(巨化股份)、冷板(中石科技)到系统集成(英维克),本土企业突破密封精度、微通道加工等瓶颈。

短期瓶颈:核心部件如快接头、CDU(冷却分配单元)供应紧张,台资企业扩产周期长,需通过代工模式缓解产能压力。